作物表型指的是在基因组与环境因素的共同影响下,作物的结构及组成、生长发育的过程以及结果所呈现出的全部物理、生理和生化方面的特征与性状[1],是由作物-环境相互作用决定的[2]。对作物表型进行精确测量是作物育种改良和提升现代农业生产精准管控的关键[3]。人工测量作为传统的作物表型数据获取的主要手段,存在样本量少、效率低、误差大、适应性弱等问题[4],难以对作物的多种性状进行综合分析和研究[5],制约了表型分析在种苗科学培育和设施农业精准管理等方面的应用[6]。因此,需建立一种快捷、精准、高通量[7]的表型参数提取方法,实现对作物生长情况的有效监测。

利用计算机视觉技术,实现对表型信息的非破坏性获取,已成为作物表型无损测量的主要技术手段。基于二维图像的作物表型测量方法具有设备要求低、操作简便等优势,但存在叶片遮挡和深度信息缺失的问题[8]。三维信息在对作物空间形态的描述方面比二维图像更准确,具有深度信息可以摆脱维度的限制,实现对作物性状更加准确和全面的监测[9]。在作物表型领域,通常采用运动恢复结构-多视图立体视觉方法进行三维重建[10],然而,该方法需要采集大量的图像,对重叠度要求较高,并且稠密点云生成过程中所需时间较长[11],这使得它不适用对表型信息进行高通量的实时获取。

随着计算机性能水平的迅速提高和传感器技术的不断升级[12],基于三维点云的作物表型研究逐渐展开,极大地提高了表型数据的获取效率[13]。Kinect传感器是一款消费级深度相机,体积小、视场角宽阔[14],可以实现对彩色图像、近红外图像和深度图像的同时获取,能实现短距离的高精度成像,在现代农业信息领域得到广泛应用[15],它不仅克服了二维图像的局限性,而且充分解决了激光雷达价格昂贵、不能广泛应用的问题[16]。与Kinect V2传感器相比,Kinect V3机身更加轻便、图像分辨率更高,深度信息更加精准、成像范围更广[17-19]。

针对作物表型参数获取存在成本高、误差大、速度慢、适用性弱等问题,本文选取叶菜类作物为研究对象,设计一种基于 Kinect V3深度传感器的作物三维重建平台,提出一种基于载物台恢复与改进ICP配准相结合的三维重建方法,对多视角点云进行快速三维重建,利用聚类分割对重建的器官点云进行单叶点云提取,以期实现对株高、叶长、叶宽、叶面积等作物表型参数的精确无损测量,为叶菜类作物高通量表型获取和分析提供技术支持。

1.1.1 数据获取

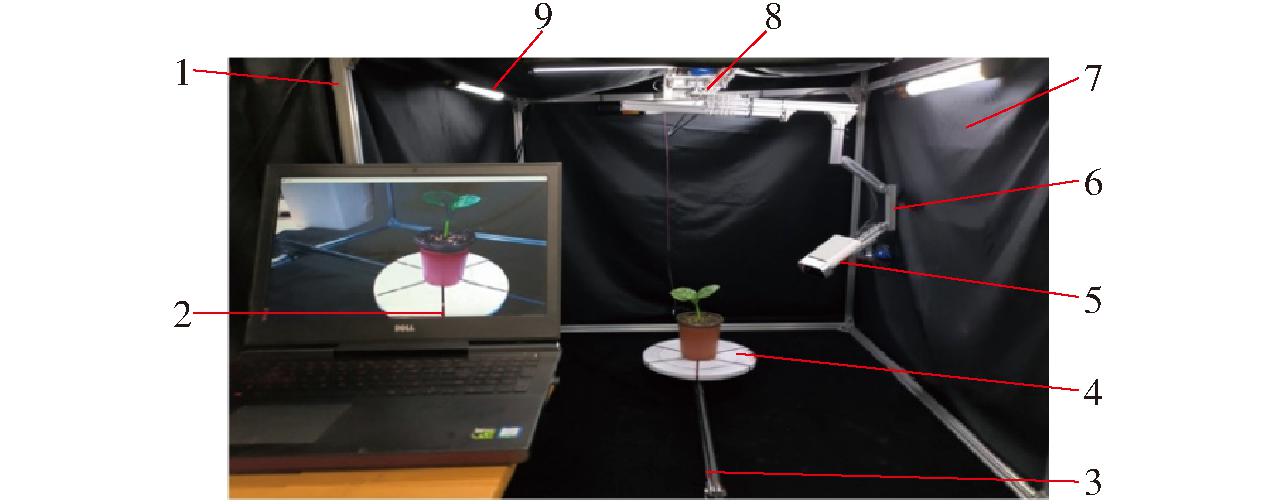

于2024年3—5月在山东省临淄设施蔬菜科技小院的日光温室中进行试验种苗培育。选取木耳菜、茄子、甘蓝、紫背天葵苗期盆栽作为试验对象。作物多视角点云采集通常采用相机固定、作物旋转的方式来进行。然而,由于作物本身刚性较差,旋转过程中易产生抖动,影响点云配准结果,导致叶片点云分层,从而降低点云重建精度。为有效降低抖动引起的重建误差,采用作物固定、相机旋转的方式进行采集。相机在旋转到指定角度后暂停3 s,以相机停止旋转作为点云捕获的触发信号,启动捕获过程,有助于生成高精度的作物点云模型。在山东理工大学智慧农业团队实验室内搭建三维重建平台,如图1所示。

图1 作物三维重建平台实物图

Fig.1 Three-dimensional reconstruction of crop platform physical map

1.铝框架 2.PC机 3.作物运输机构 4.载物台 5.Kinect V3传感器 6.相机高度调整机构 7.摄影布 8.相机旋转机构 9.RGB补光灯

三维重建平台包括作物运输机构、相机高度调整机构、图像采集装置、相机旋转机构4部分。作物运输通过传送滑台来实现,利用42步进电机与YF-31驱动控制一体板结合,驱动皮带传动实现滑台移动,将载物台上的作物盆栽运送到指定位置,并在采集结束后自动将作物盆栽退出采集区域,以采集下一株作物。相机高度调整通过机械臂来实现,2020型材搭配活动铰链,可以对相机高度、相机与作物之间的距离进行调整,调整到适当位置后紧固活动铰链进行锁死。图像采集装置,在Visual Studio 2019开发环境下,采用PCL库和Azure Kinect SDK开发包,使用C++编程实现1 920像素×1 080像素的彩色图、1 024像素×1 024像素的深度图和1 024像素×1 024像素的近红外图的获取与对齐。相机旋转机构以STM32F103C8T6单片机作为控制器,控制多级DHEA-CB型大扭矩舵机转动,编程实现舵机间隔预设角度的间歇旋转,从而带动相机围绕作物进行360°多角度拍摄。铝型材框架外安装黑色摄影布遮挡外界光线,加装RGB补光灯管提供稳定光源。

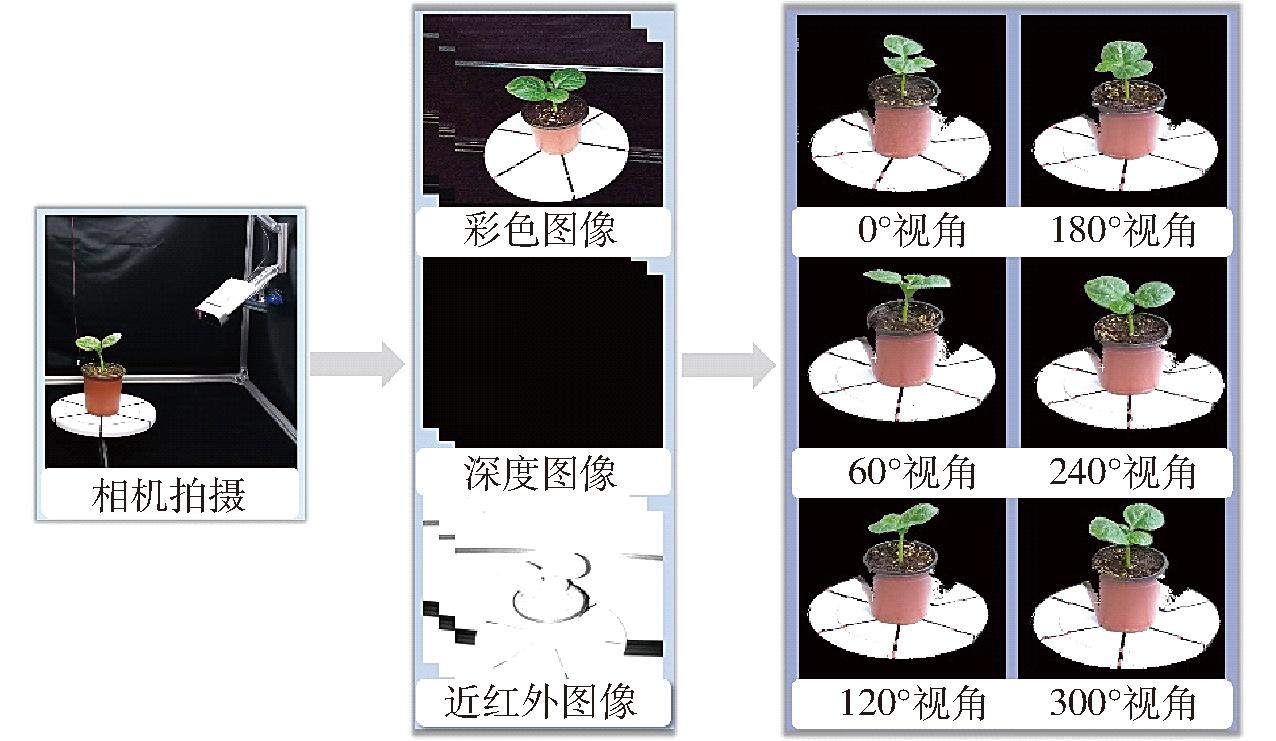

在使用三维重建平台进行图像采集时,首先,对空载的载物台进行多视角的图像采集。接着,将作物盆栽放置于载物台上,通过程序控制,使相机顺时针旋转,每隔预设角度进行一次图像采集,完成360°多视角图像采集。为减少试验误差,每个角度采集3帧图像,并利用提供的SDK函数,将3帧深度图和3帧彩色图分别以第1帧图像为基础进行叠加融合。融合后的深度图和彩色图进行对齐处理,并将其转换为点云,采用直通滤波对无关背景点云进行去除。采用60°间隔进行点云采集,采集结果如图2所示。

图2 Kinect V3传感器采集的多视角点云

Fig.2 Multi-view point cloud captured by Kinect V3 sensor

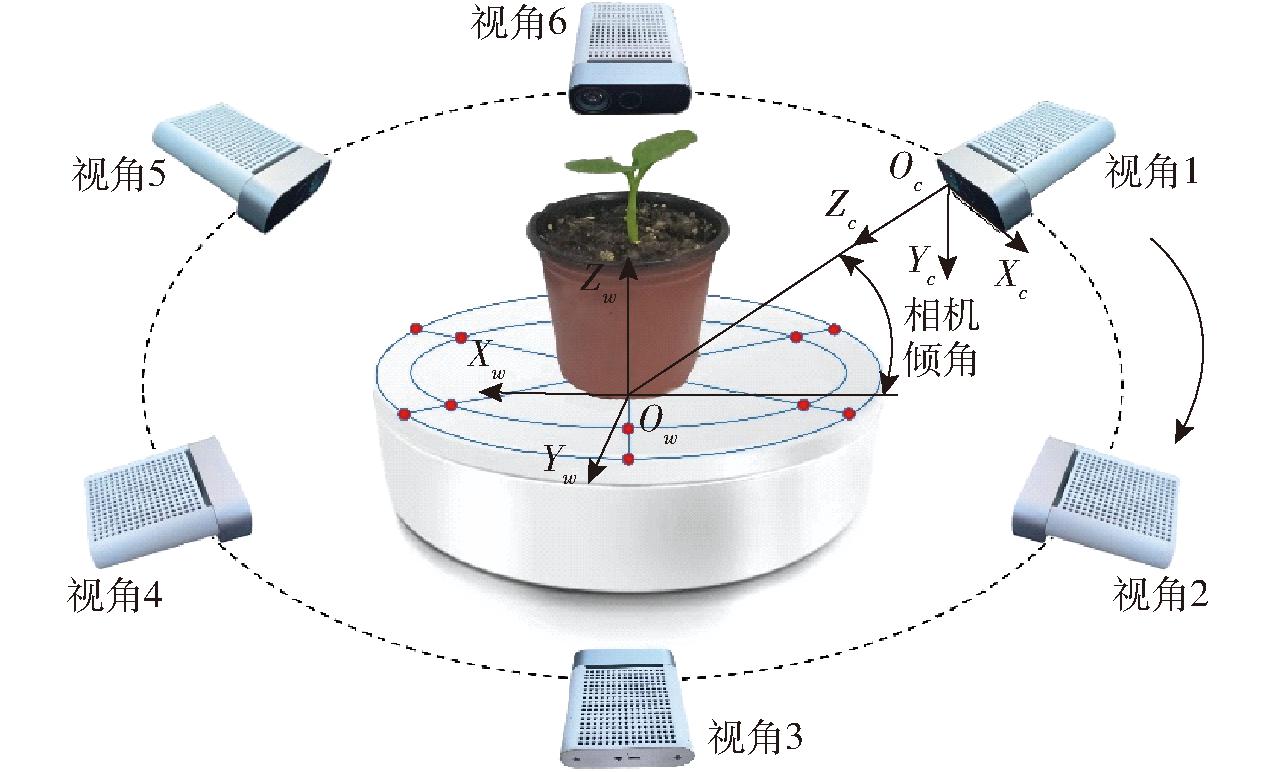

1.1.2 坐标校正

由于所采集原始点云均处于相机坐标系OcXcYcZc下,如图3所示,点云水平面不平行于世界坐标系OwXwYwZw的XwOwYw平面,导致不同视角下的点云坐标系不同,为方便后续多视角点云配准,需对原始点云进行水平校正,实现坐标统一。

图3 坐标系示意图

Fig.3 Coordinate system diagram

利用6个视角(视角1~6分别表示0°、60°、120°、180°、240°、300°视角)空载的载物台点云,用随机采样一致性(Random sample consensus,RANSAC)算法[20]对台面点云所在平面进行检测,检测出其所在的平面方程

Aix+Biy+Ciz+D=0

(1)

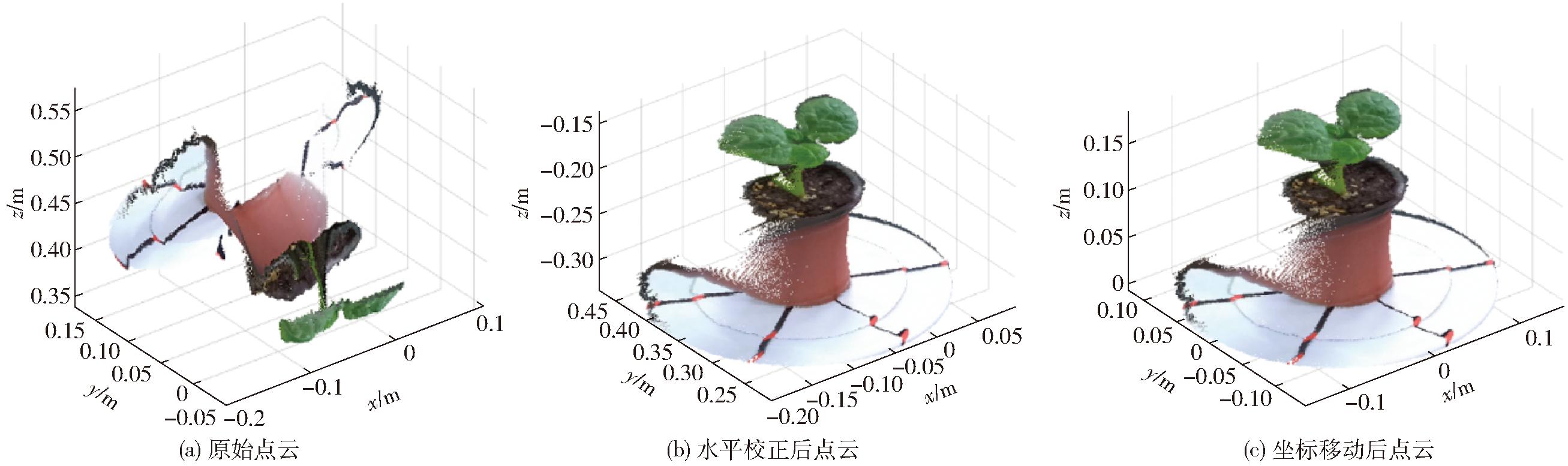

式中i表示视角序号,第i个视角平面法向量为Vi=(Ai,Bi,Ci),取6组法向量信息的均值,作为台面点云的法向量V=(A,B,C)。首先,在世界坐标系下,(0,0,1)为XOY面法向量,利用矩阵变换计算两向量夹角得到旋转矩阵R,将旋转矩阵R应用到台面点云,使台面点云法向量旋转到与世界坐标XOY水平面的法向量同向,实现点云水平校正;其次,对于水平校正后的台面点云利用凸包检测法提取轮廓边界,使用RANSAC算法选择空间圆作为拟合模型[21],对轮廓点云进行拟合得到其圆心坐标Oj(Xj,Yj,Zj),计算均值作为台面点云的圆心坐标O(X,Y,Z),计算平移变换矩阵T将台面点云的圆心移动到世界坐标系的原点,实现坐标统一;最后,对采集到的作物多视角点云应用上述旋转矩阵R和平移变换矩阵T,实现点云坐标校正。坐标校正结果如图4所示。

图4 点云坐标校正

Fig.4 Point cloud coordinate correction

1.1.3 点云滤波

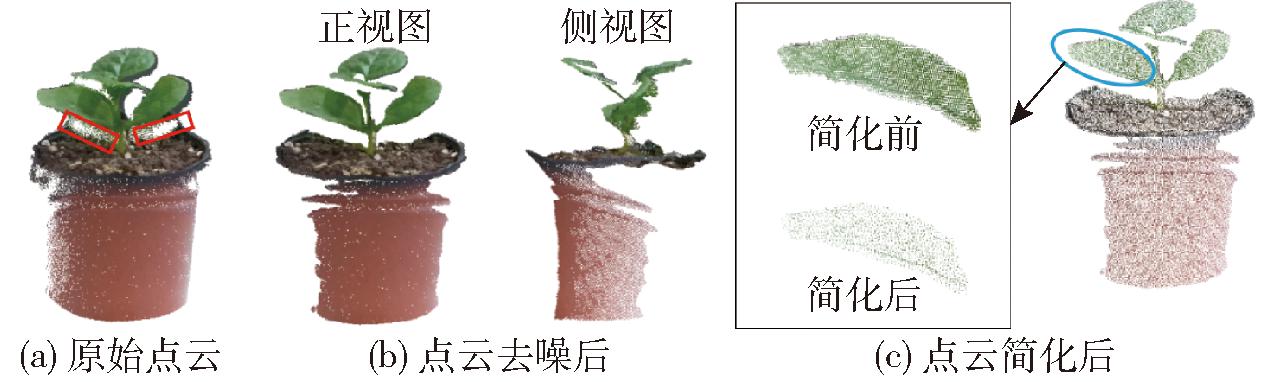

点云滤波可实现离群噪点的去除和点云数量的简化。利用Kinect V3传感器得到的点云数据包含许多噪点,如图5a所示,红框部分代表点云噪点。噪点的存在会对后续多视角点云配准产生影响,造成误差累积,使得最后表型测量结果不准确。因此为提高点云重建质量,获取精确的表型测量结果,需对点云进行去噪处理,本文采用统计滤波器[22]和半径滤波器结合的方式对噪点进行高效去除。利用统计滤波器对空间中分布稀疏的离群点进行去除,再采用半径滤波器去除剩余的单个离群点。通过多次尝试,将统计滤波器的邻近点个数Ks设置为120、标准差倍数α设置为1,半径滤波器的半径邻域r设置为0.5、邻域点集数Kr设置为100,可较好地保留边界,有效去除噪点,叶片边缘更加清晰,如图5b所示。

图5 点云滤波结果

Fig.5 Point cloud filtering results

由于采用高分辨率的Kinect V3传感器进行三维重建,致使所得作物点云数据量较大,影响算法的处理速度,因此需要对三维作物模型进行简化处理,在保证点云本身几何结构的前提下降低点云数量。本文采用改进体素滤波法,构建三维体素栅格,体素重心点以点云数据中距离最近的点来代替,从而近似表示体素栅格中的其他点,实现在点云简化的同时保留点云细小特征。根据所采集的原始点云大小,设置栅格体素大小为0.001,可较好地实现下采样,滤波结果如图5c所示,黑色框内为蓝色椭圆区域点云在体素滤波前后放大相同倍数的示意图。

1.2.1 点云配准方法

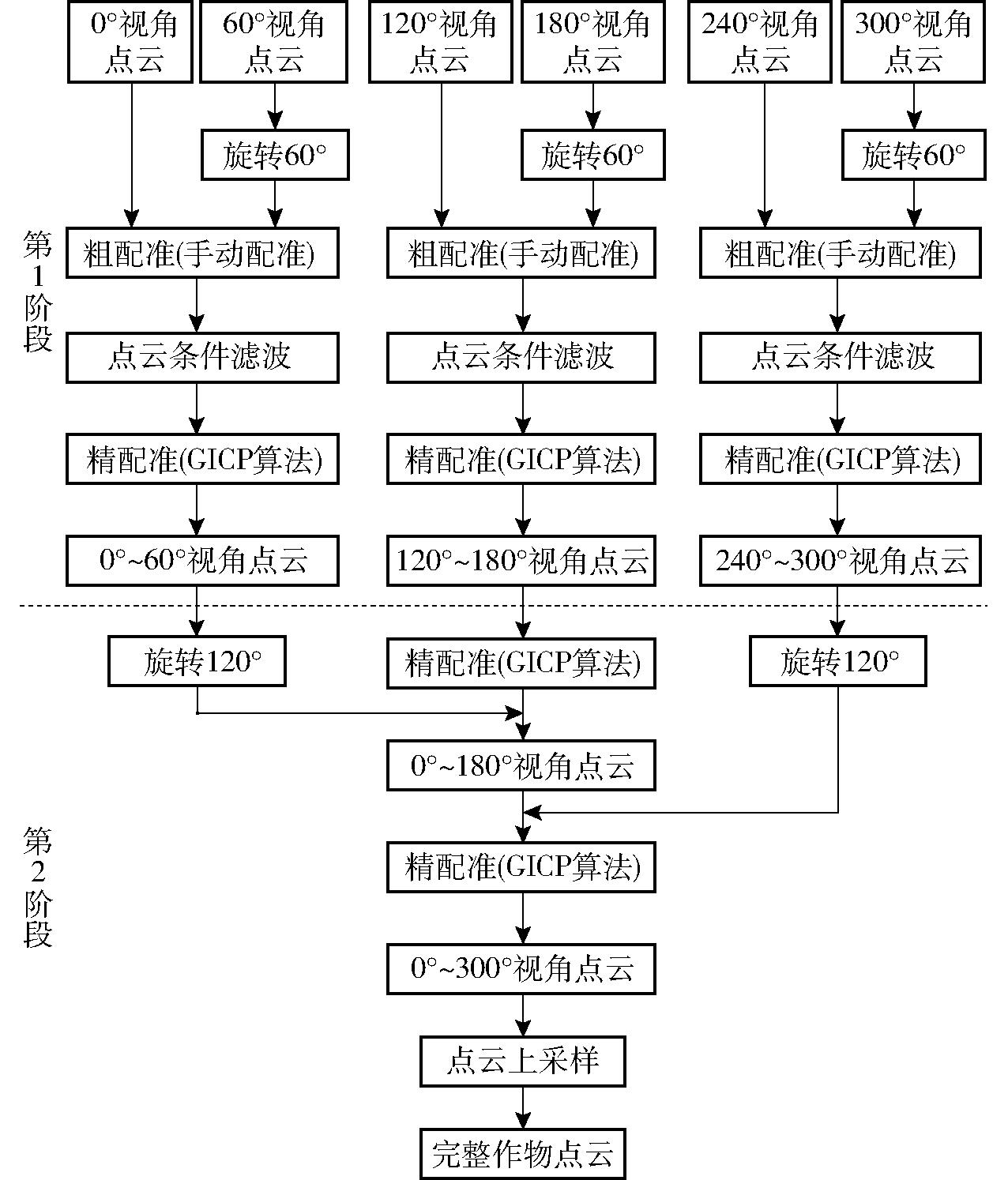

为生成完整的作物点云,需对Kinect V3传感器获取的不同角度的单视角点云进行配准。采用载物台恢复与广义迭代最近点算法(Generalized iterative closest point,GICP)相结合的方式对获取的多角度点云进行配准拼接,从而获得完整点云,配准流程如图6所示。

图6 多视角点云配准流程图

Fig.6 Multi-view point cloud registration flowchart

第1阶段相邻两视角点云配准,包括2部分:①点云粗配准阶段,采用60°间隔进行点云采集,因此相邻2个视角旋转角度为60°。以Z轴作为旋转轴,旋转使两相邻视角的点云坐标一致,再结合特制台面进行基于对应点的刚体变换配准,选取3对特制台面的特征点和2对作物点云的特征点,计算变换矩阵进行刚体变换。②点云精配准阶段,采用比经典 ICP 算法适用范围更广的GICP 算法[23]进行配准。首先对点云进行预处理,采用条件滤波算法通过设置滤波维度及范围对载物台进行去除,减少不必要的运算,提高准确性;再结合每个点的局部表面特性,通过协方差矩阵描述点的局部几何结构,提高对噪声和局部误差的容忍度;最后以马氏距离作为优化目标,能够更准确地反映点对之间的几何关系,提升了配准鲁棒性和精度。

第2阶段6个视角点云配准,包括2个步骤:①经过第1阶段得到配准结果为0°~60°视角点云、120°~180°视角点云、240°~300°视角点云,分别将0°~60°视角点云、240°~300°视角点云旋转120°,使其与120°~180°视角点云坐标系一致,依次与120°~180°视角点云进行配准,选取特征点进行点云粗配准,利用GICP算法进行点云精配准,得到完整的作物点云。②采用移动最小二乘法[24](Moving least squares,MLS)对作物点云进行上采样,通过局部平面拟合和平滑算法,消除了点云中的噪声,确保点云具备良好的连续性。

1.2.2 重建质量评价方法

以SFM-MVS算法重建点云作为参照,采用Agisoft Metashape软件对手机获取的作物图像进行三维重建获得参照组点云。以花盆外径(12 cm)作为尺寸基准,计算比例因子,对参照组点云进行尺寸恢复。重建方案不同点云坐标系不同,需要对重建点云和参照组点云进行坐标统一,使其点云对齐,计算2种方法所得重建点云的点对距离分布,重建点云的相似度评价通过点对距离均方根误差R来实现,均方根误差越小,点云相似度越高,点云重建质量越好。

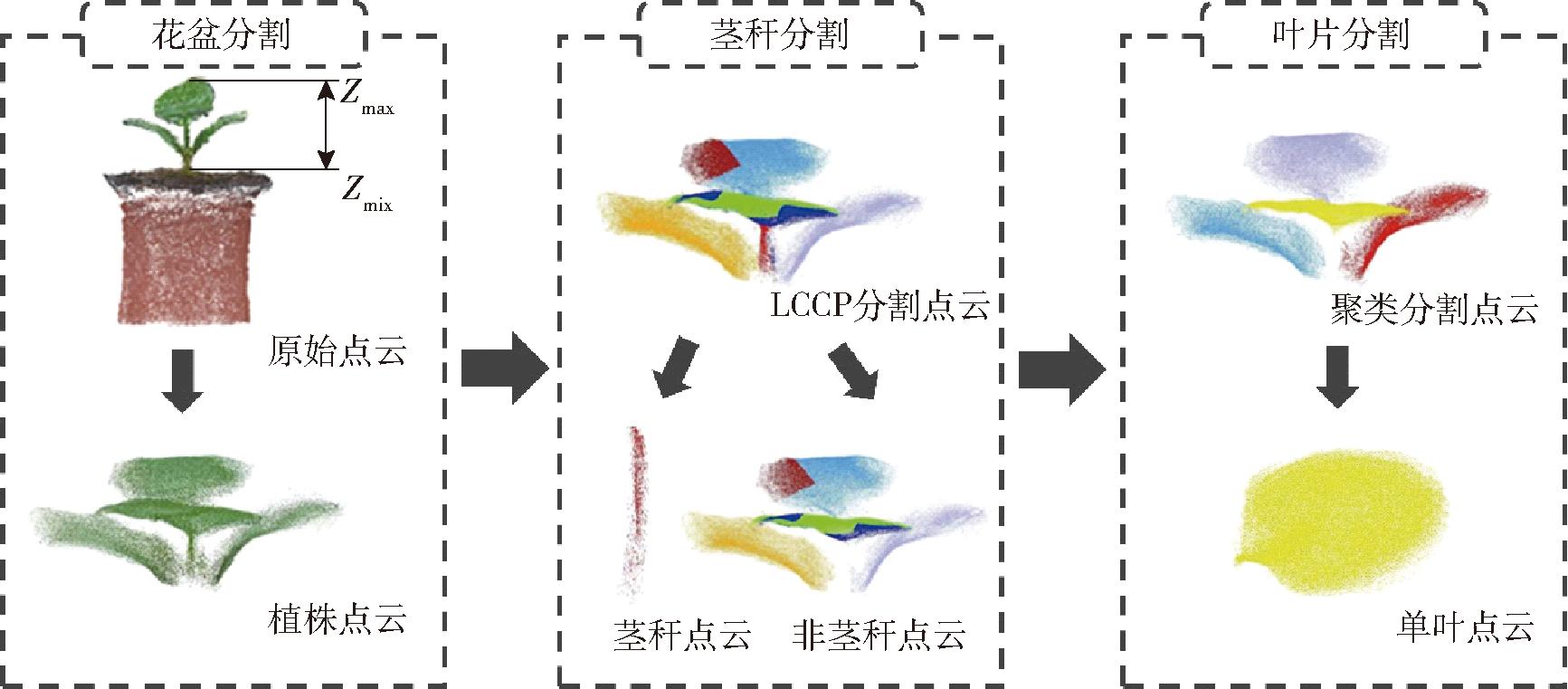

正确、有效地对作物点云数据进行分割是表型参数准确测量的前提。作物点云分割由花盆分割、茎秆分割和叶片分割组成,如图7所示。

图7 点云分割示意图

Fig.7 Sketch of point cloud segmentation

(1)花盆分割:对原始点云进行直通滤波处理,坐标校正后作物生长方向沿着Z轴的正方向,选择Z轴作为滤波维度,设置阈值条件

Zmin≤Z≤Zmax

(2)

式中 Z——植株点云中任意一点Z轴坐标

Zmin——植株点云Z轴方向坐标最小值

Zmax——植株点云Z轴方向坐标最大值

遍历所有点云,对在阈值范围内的点进行保留,将不在阈值范围内的点即花盆点云进行去除,减少后续不必要的运算。

(2)茎秆分割:采用凹凸性分割算法(Locally convex connected patches,LCCP)[25]对单株作物点云进行分割。该算法分为3部分:①根据点云的法向量夹角和空间距离以超体素为单位对点云进行过分割。②通过扩展凸性准则(Extended convexity criterion,CC)和合理性准则(Sanity criterion,SC)来判断邻近超体素之间的凹凸性关系。③在标记完各个小区域的凹凸关系后,合并所有凸链接超体素构成分割结果,基于随机采样一致性算法对其进行直线拟合,对茎秆点云所在超体素区域进行抽取,实现茎秆分离。

(3)叶片分割:采用区域生长算法,从非茎秆点云中曲率最小的种子点开始生长,通过设置法向量夹角阈值和曲率差值阈值对其进行生长聚类,将初始种子附近具有相似特征的点集合起来,输出聚类的集合来提取独立完整的叶片点云,并设置聚类点数阈值将较小的叶片或噪点进行去除,从而实现叶片点云分割。

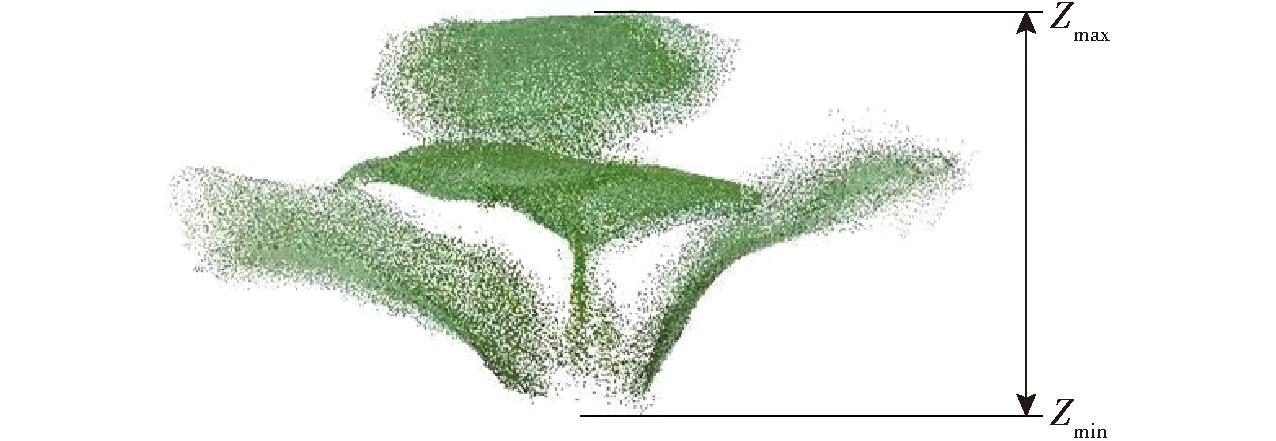

1.4.1 株高

株高是评价作物生长情况的重要指标,在农业生产中有着非常重要的应用价值。点云预处理阶段已对坐标进行校正,以作物点云在Z轴坐标最大值和最小值之差作为株高,采用距离最值遍历计算,如图8所示。

图8 作物株高提取

Fig.8 Sketch of plant height extraction

作物株高H计算公式为

H=Zmax-Zmin

(3)

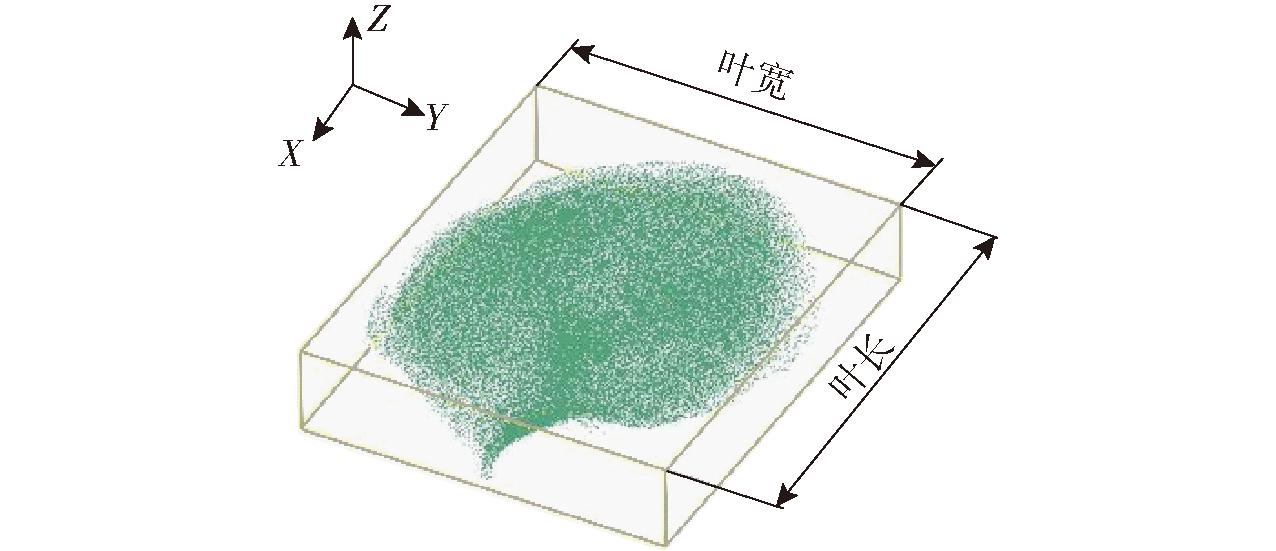

1.4.2 叶长、叶宽

采用主成分分析法(Principal component analysis,PCA)构建坐标轴方向任意的可包含作物对象的最小长方体——有向包围盒(Oriented bounding box,OBB),以不同主方向上包围盒长度分别作为叶长和叶宽。以点云分割后单叶点云作为输入,通过主成分分析法获得叶片点云的主方向、质心,求解协方差,获得协方差矩阵,计算协方差矩阵的特征值和特征向量,特征值从大到小排序,对应的特征向量作为叶片点云的3个主成分方向。根据质心和主方向计算变换矩阵,将叶片点云转换至原点,且主方向与坐标系同向,以坐标系极值为参考构建点云有向包围盒,如图9所示。以叶片点云第一主成分方向上即X轴的边界值作为叶长,以叶片点云第二主成分方向上即Y轴边界值作为叶宽。

图9 叶长叶宽提取

Fig.9 Extraction of leaf length and leaf width

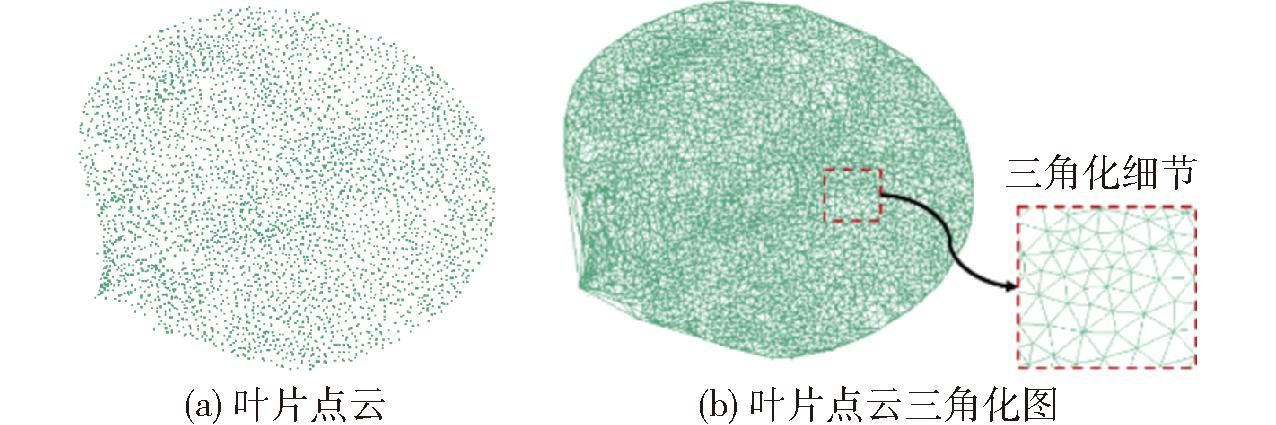

1.4.3 叶面积

叶面积是衡量叶片尺寸的重要特征,对其进行合理调控可起到增产作用,对监测作物生长具有重要意义。采用贪婪投影三角化算法对叶片点云进行表面重建,构建叶片点云三角网格模型,如图10所示。

图10 贪婪投影三角化重建的点云三角网格模型

Fig.10 Triangular network model of point cloud reconstructed by greedy projection triangulation algorithm

利用海伦公式计算每个三角形面积Ai,然后对所有三角形面积进行累加求和作为所求叶片叶面积

(4)

其中![]()

(5)

(6)

式中 A——叶片面积

ai、bi、ci——三角形边长

pi——三角形周长的一半

1.4.4 表型参数精度评估

以人工测量的表型参数作为参考值,对三维点云模型测量所得参数进行准确性评价,通过对作物进行离体测量来获取株高、叶长、叶宽、叶面积等参数,并采用均方根误差(Root mean squared error,RMSE)、平均绝对百分比误差(Mean absolute percentage error,MAPE)和决定系数(R2)作为精度评价指标。具体操作为:首先采用卷尺对株高进行测量;再依次将叶片摘下,置于黑色摄影布上,并将透明亚克力板盖于叶片之上,保证叶片处于非卷曲状态。采用手机垂直拍摄获取叶片图像,将图像导入开源图像处理软件ImageJ中,以30 cm钢尺作为基准,计算图像像素与实际尺寸之间的比例关系,来获取叶面积、叶长和叶宽。以沿着主叶脉方向,从叶片的基部(与叶柄相连的一端)到叶片顶端的距离作为叶长,以沿着主叶脉垂直方向的最宽处长度作为叶宽。为减少试验误差,尽量提高测量精度和准确性,采用多次重复测量取平均值的方法对其进行测量。

对同一作物植株,分别运用本文方法与 SFM-MVS 方法进行三维重建,重建所得结果如图11a、11b所示,从图中可以看出:①在重建完整度方面,当重建对象纹理信息过少时,SFM-MVS方法不能实现很好的特征匹配,例如花盆点云的重建过程中,SFM-MVS方法存在点云缺失,而本文方法可以对其实现完整重建。②在作物点云纹理信息方面,本文方法可以保留部分纹理信息,但仍有个别叶片存在纹理缺失和模糊,而SFM-MVS方法可以更好地关注图像的纹理特征。

图11 重建效果对比

Fig.11 Comparison chart of reconstruction effect

图11c展示了以SFM-MVS重建点云与本文方法重建点云间的点对距离分布,木耳菜、甘蓝、茄子和紫背天葵点对距离均方根误差分别为0.381、0.340、0.195、0.270 cm,并且点对距离误差小于1 cm的点均占比90%以上,点对距离误差小于0.50 cm的点均占比达到75%以上。通过实现重建质量可视化,可以看出蓝色区域分布广泛,表示重建质量较好,说明两者具有较好相似性。

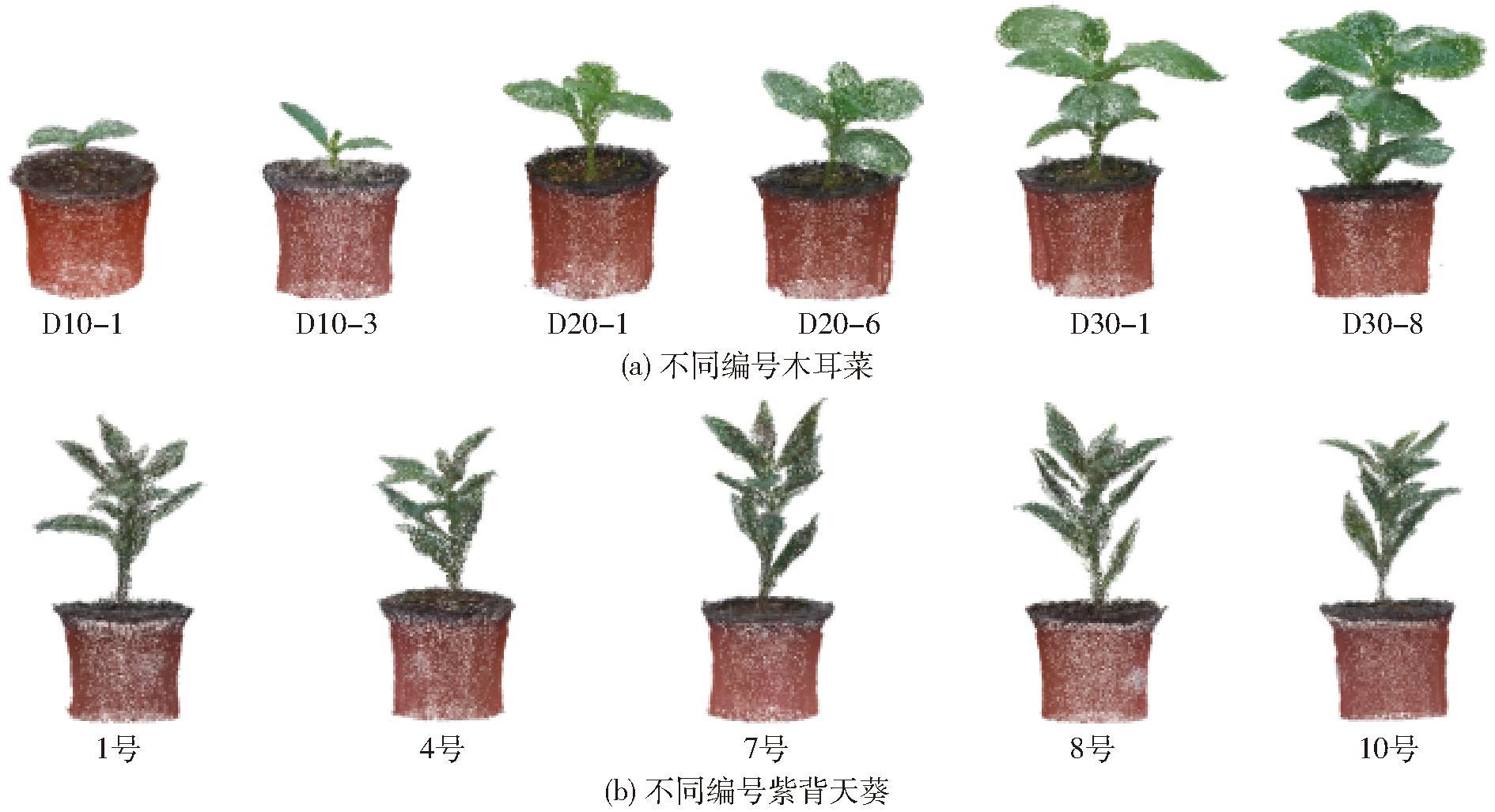

为验证本文方法对于不同生长时期作物三维重建的鲁棒性,选择木耳菜为试验对象,在移栽后的第10天、第20天、第30天(D10、D20、D30)分别进行三维重建试验,部分不同时期的木耳菜重建点云如图12a所示,对3个不同时期的各10组,共计30组木耳菜点云数据进行统计,其平均点对的均方根误差为0.391 cm。为验证本文方法对于不同叶片形态作物三维重建的可靠性,选择同一时期的10株紫背天葵进行三维重建,部分重建效果如图12b所示,其平均点对的均方根误差为0.275 cm,均表现出较高的相似性。重建效率方面,与郑立华等[16]采集16个视角的点云数据进行三维重建相比,本文方法采集角度减少,单角度的图像帧数降低,重建效率高。重建质量方面,与陈海波等[17]工作相比,在点云采集阶段,采用低成本三维重建平台进行采集,可以避免作物抖动,较作物旋转相机固定的采集方式,其重建点云的点对距离均方根误差均值降低42.54%,点对距离误差小于0.50 cm的点占比提升10%以上。

图12 本文方法部分重建效果图

Fig.12 Reconstruction effect diagrams of method section

增加基于点对的刚体变换后,为量化其对点云粗配准效果的影响,以两相邻视角点云间距离均方根误差作为配准误差,选用D20-5号木耳菜点云进行粗配准,并对配准后两相邻视角点云的配准误差进行数据统计分析,结果显示其配准误差均值为1.425 cm,与增加基于点对的刚体变换前相比,配准误差降低0.396 cm,较郑立华等[16]、陈海波等[17]粗配准后的配准误差分别降低0.595 cm和1.335 cm。

三维重建后,对作物表型参数进行提取,提取参数包括株高、叶长、叶宽和叶面积。为有效评价本文方法表型参数提取的准确性,随机选取D10时期的15株木耳菜、D20时期的10株木耳菜、D30时期的5株木耳菜和D30时期的10株紫背天葵作为试验对象,将不易进行人工测量、对作物长势评估影响较小的小叶片进行剔除,最终统计不同时期的各30片木耳菜叶片和同一时期的100片紫背天葵叶片,将本文方法所提取参数与人工测量值进行对比,采用均方根误差、平均绝对百分比误差和决定系数作为衡量精度的评价指标。各表型参数提取值与人工测量值进行线性拟合和误差计算,结果如图13所示。

图13 表型参数提取结果评估

Fig.13 Evaluation of results of phenotypic parameter extraction

由图13a可以看出,3个生长时期木耳菜株高、叶长、叶宽、叶面积决定系数分别为0.952~0.972、0.966~0.977、0.922~0.957、0.910~0.973,均方根误差分别为0.354~0.373 cm、0.176~0.239 cm、0.196~0.433 cm、1.001~5.484 cm2,平均绝对百分比误差为2.831%~4.942%、2.863%~3.932%、4.402%~5.393%、7.035%~9.759%。D10时期处于子叶展平期,叶片较为平整,叶片各表型参数的均方根误差最小。D20时期处于四叶一心时期,叶片卷曲现象不明显,叶片较大易测量,各表型参数决定系数最高,株高、叶长、叶宽平均绝对百分比误差最小。D30时期处于八叶一心时期,叶片卷曲,存在遮挡现象,叶面积平均绝对百分比误差较大,但仍小于10%,在可接受范围内。不同生长时期作物表型参数提取决定系数均大于0.910,平均绝对百分比误差均小于9.759%,木耳菜3个生长时期株高、叶长、叶宽、叶面积均方根误差均值为0.366 cm、0.203 cm、0.290 cm、3.182 cm2,平均绝对百分比误差均值为3.647%、3.338%、4.895%、8.585%,决定系数均值为0.964、0.972、0.935、0.948,表明本文方法对作物3个生长时期的表型参数提取均具有较高的可靠性。

由图13b可得,紫背天葵株高、叶长、叶宽和叶面积提取值与人工测量值均方根误差分别为0.496 cm、0.344 cm、0.282 cm、0.825 cm2,平均绝对百分比误差分别为2.672%、5.219%、5.629%、9.737%,决定系数分别为0.956、0.955、0.903、0.934。结果表明,本文方法对木耳菜和紫背天葵株高提取的均方根误差最大值为0.496 cm,决定系数均值为0.962;木耳菜和紫背天葵叶长提取的均方根误差最大值为0.344 cm,决定系数均值为0.968。木耳菜和紫背天葵叶面积提取的均方根误差最小值为0.825 cm2,远小于文献[17]均方根误差最小值2.08 cm2,降幅达60.34%,D30时期木耳菜叶面积均方根误差为5.484 cm2,略大于文献[17]均方根误差最大值3.83 cm2,但其他时期均方根误差均小于3.83 cm2。本文方法提取的作物表型参数平均绝对百分比误差不高于9.759%,处于较低水平,决定系数R2不低于0.903,说明提取值与人工测量值具有较高一致性。

对试验中存在的表型参数提取误差进行分析,得出:①作物生长过程中具有趋光性,使得作物向光生长产生茎秆弯曲,导致株高测量时产生误差。育苗盆内土壤不平整也会造成株高的测量值与真值之间存在一定误差。②人工测量过程中,叶片卷曲会使叶片边缘部分向内卷曲或者向外卷曲,影响ImageJ软件对叶片边缘的识别,导致测量不准确。③在叶面积的测量过程中,三维重建造成的叶片点云空洞,会使三维测量值大部分都小于人工测量值,极少数部分由于噪声点的存在会使其大于人工测量值。

综上所述,虽基于本文方法的表型参数提取存在一定误差,但与人工测量值较为接近,相关性较好,可应用于作物表型参数获取。

与文献[17]研究相比,本文创新性体现在以下几个方面:①点云采集方面,采用低成本三维重建平台进行采集,其特点是作物不动、相机旋转。与现有作物旋转、相机固定的采集方式相比,该方法可以避免作物晃动,减少重建叶片点云分层现象,提高重建质量和效率,重建点云的点对距离均方根误差均值降低42.54%。②点云配准方面,在粗配准阶段增加了基于点对的刚体变换,与只进行转台变换的粗配准相比,该方法可使两相邻视角点云配准误差均值降低1.335 cm;而且,在精配准阶段采用配准精度更高的GICP算法,虽然相对 TrICP来说,GICP对初始值的要求较高,但粗配准阶段本文采用的基于特征点对的初始化可以提高初始值的准确性,避免其陷入局部最优解。③点云滤波方面,采用统计滤波器和半径滤波器相结合的方式,与单一预设值的统计滤波方式相比,该方法对不同类型的噪声源具有较强的适应性;使用传感器获取点云难免会出现近密远疏的现象,在结合半径滤波器后,可以根据点云的局部密度调整滤波策略,能够关注每个点局部邻域,更好地处理局部的噪声点。④叶面积提取精度方面,采用凹凸性分割算法和区域生长算法相结合的方式进行单叶提取,其叶面积提取的均方根误差最小值由2.08 cm2降低到0.825 cm2,降幅达60.34%。

基于三维重建进行作物表型参数获取,可以避免作物损伤,做到无损检测,实现作物长时间动态监测,但仍存在一些问题:在单叶片提取时,茎叶分割部分的点云聚类算法需要人工反复调参获得最佳分割效果,后期可考虑利用深度学习的语义分割来实现茎叶器官自动化提取;在多视角点云配准时,未进行错误点对去除,仍存在未正确配准的点,后期可根据点对距离对其进行去除,提高作物三维重建精度。

(1)提出了一种基于Kinect V3传感器的叶菜类作物三维重建与表型参数无损获取方法,该方法首先基于Kinect V3 深度传感器获取单视角三维点云,结合坐标校正、点云滤波对其进行预处理,并采用基于载物台恢复与广义迭代最近点算法相结合的方式对获取的多角度点云进行配准拼接,从而获得完整点云,对其进行茎叶分割聚类单叶点云,分割后提取株高、叶长、叶宽、叶面积等表型参数。

(2)设计了一种低成本的作物三维重建平台,可实现对作物进行多角度多机位的点云数据采集,利用C++程序与STM32单片机来控制作物运输、相机旋转与拍照,该装置不会造成作物抖动,60 s内可完成作物6个视角的点云获取,提高采集效率。通过固定相机位置,只需拟合一次载物台信息,便可进行多株作物点云的坐标校正,减少计算量,进一步提高重建效率。

(3)本文方法重建的作物点云与SFM-MVS算法重建的参照组点云进行对比,木耳菜、甘蓝、茄子、紫背天葵点对距离均方根误差分别为0.381、0.340、0.195、0.270 cm,30组木耳菜点云点对距离均方根误差均值为0.391 cm,10组紫背天葵点云点对距离均方根误差均值为0.275 cm,至少有75%的点对距离分布在0.50 cm以内,90%的点对距离分布在1 cm以内,粗配准后两相邻视角点云的配准误差均值为1.425 cm,相似度高,重建质量好。

(4)利用本文方法得到的重建点云进行表型数据获取,株高、叶长、叶宽、叶面积参数测量值与人工实测值的木耳菜和紫背天葵均方根误差分别为0.366 cm、0.203 cm、0.290 cm、3.182 cm2和0.496 cm、0.344 cm、0.282 cm、0.825 cm2,平均绝对百分比误差不高于9.759%,决定系数R2不低于0.903。本文所提出的测量方法精确度较高,可以较好地替代人工测量。

[1] 潘映红.论植物表型组和植物表型组学的概念与范畴[J].作物学报,2015,41(2):175-186.PAN Yinghong.Analysis of concepts and categories of plant phenome and phenomics[J].Acta Agronomica Sinica,2015,41(2):175-186.(in Chinese)

[2] 赵春江.植物表型组学大数据及其研究进展[J].农业大数据学报,2019,1(2):5-18.ZHAO Chunjiang.Big data of plant phenomics and its research progress[J].Journal of Agricultural Big Data,2019,1(2):5-18.(in Chinese)

[3] 岑海燕,朱月明,孙大伟,等.深度学习在植物表型研究中的应用现状与展望[J].农业工程学报,2020,36(9):1-16.CEN Haiyan,ZHU Yueming,SUN Dawei,et al.Current status and prospects of deep learning in plant phenotype research[J].Transactions of the CSAE,2020,36(9):1-16.(in Chinese)

[4] 张慧春,周宏平,郑加强,等.植物表型平台与图像分析技术研究进展与展望[J].农业机械学报,2020,51(3):1-17.ZHANG Huichun,ZHOU Hongping,ZHENG Jiaqiang,et al.Research progress and prospect of plant phenotype platform and image analysis technology[J].Transactions of the Chinese Society for Agricultural Machinery,2020,51(3):1-17.(in Chinese)

[5] 翁杨,曾睿,吴陈铭,等.基于深度学习的农业植物表型研究综述[J].中国科学:生命科学,2019,49(6):698-716.WENG Yang,ZENG Rui,WU Chenming,et al.A survey on deep-learning-based plant phenotype research in agriculture[J].Scientia Sinica Vitae,2019,49(6):698-716.(in Chinese)

[6] 袁培森,李润隆,任守纲,等.表示学习技术研究进展及其在植物表型中应用分析[J].农业机械学报,2020,51(6):1-14.YUAN Peisen,LI Runlong,REN Shougang,et al.Research progress of representation learning technology and its application analysis in plant phenotyping[J].Transactions of the Chinese Society for Agricultural Machinery,2020,51(6):1-14.(in Chinese)

[7] LI D,SHI G,LI J,et al.PlantNet:a dual-function point cloud segmentation network for multiple plant species[J].ISPRS Journal of Photogrammetry and Remote Sensing,2022,184:243-263.

[8] YANG D,YANG H,LIU D,et al.Research on automatic 3D reconstruction of plant phenotype based on multi-view images[J].Computers and Electronics in Agriculture,2024,220:108866.

[9] 王瑞萍,刘东风,王先琳,等.基于多视图几何的白菜薹分割与关键表型测量[J].农业工程学报,2022,38(16):243-251.WANG Ruiping,LIU Dongfeng,WANG Xianlin,et al.Segmentation and key phenotype measurement of Chinese cabbage shoots based on multi-view geometry[J].Transactions of the CSAE,2022,38(16):243-251.(in Chinese)

[10] 宫金良,刘镔霄,魏鹏,等.基于相机位姿恢复与神经辐射场理论的果树三维重建方法[J].农业工程学报,2023,39(22):157-165.GONG Jinliang,LIU Binxiao,WEI Peng,et al.Three-dimensional reconstruction method of fruit trees based on camera pose recovery and neural radiative field theory[J].Transactions of the CSAE,2023,39(22):157-165.(in Chinese)

[11] 朱磊,江伟,孙伯颜,等.基于神经辐射场的苗期作物三维建模和表型参数获取[J].农业机械学报,2024,55(4):184-192,230.ZHU Lei,JIANG Wei,SUN Boyan,et al.Three-dimensional modeling and phenotypic parameter acquisition of seedling crops based on neural radiation field[J].Transactions of the Chinese Society for Agricultural Machinery,2024,55(4):184-192,230.(in Chinese)

[12] 程曼,袁洪波,蔡振江,等.田间作物高通量表型信息获取与分析技术研究进展[J].农业机械学报,2020,51(增刊1):314-324.CHENG Man,YUAN Hongbo,CAI Zhenjiang,et al.Research progress on high-throughput phenotype information acquisition and analysis technology for field crops[J].Transactions of the Chinese Society for Agricultural Machinery,2020,51(Supp.1):314-324.(in Chinese)

[13] 柴宏红,邵科,于超,等.基于三维点云的甜菜根表型参数提取与根型判别[J].农业工程学报,2020,36(10):181-188.CHAI Honghong,SHAO Ke,YU Chao,et al.Extraction of sugar beet root phenotype parameters and root type discrimination based on three-dimensional point cloud[J].Transactions of the CSAE,2020,36(10):181-188.(in Chinese)

[14] 彭孝东,何静,时磊,等.基于激光雷达和Kinect相机点云融合的单木三维重建[J].华中农业大学学报,2023,42(2):224-232.PENG Xiaodong,HE Jing,SHI Lei,et al.Three-dimensional reconstruction of individual trees based on point cloud fusion of laser radar and Kinect cameras[J].Journal of Huazhong Agricultural University,2023,42(2):224-232.(in Chinese)

[15] 徐胜勇,李磊,童辉,等.基于RGB-D相机的黄瓜苗3D表型高通量测量系统研究[J].农业机械学报,2023,54(7):204-213,281.XU Shengyong,LI Lei,TONG Hui,et al.Research on high-throughput 3D phenotype measurement system of cucumber seedlings based on RGB-D camera[J].Transactions of the Chinese Society for Agricultural Machinery,2023,54(7):204-213,281.(in Chinese)

[16] 郑立华,王露寒,王敏娟,等.基于Kinect相机的油麦菜自动化三维点云重建[J].农业机械学报,2021,52(7):159-168.ZHENG Lihua,WANG Luhan,WANG Minjuan,et al.Automatic 3D point cloud reconstruction of Brassica oleracea L.based on Kinect camera[J].Transactions of the Chinese Society for Agricultural Machinery,2021,52(7):159-168.(in Chinese)

[17] 陈海波,刘圣搏,王乐乐,等.基于Kinect V3的单株作物自动化三维重建与验证[J].农业工程学报,2022,38(16):215-223.CHEN Haibo,LIU Shengbo,WANG Lele,et al.Automatic three-dimensional reconstruction and validation of individual crops based on Kinect V3[J].Transactions of the CSAE,2022,38(16):215-223.(in Chinese)

[18] 王斐,周扬,龙伟,等.基于三维点云的木荷幼苗表型参数自动测量方法[J].传感器与微系统,2024,43(5):121-124.WANG Fei,ZHOU Yang,LONG Wei,et al.Automatic measurement method of Schima superba seedling phenotype parameters based on three-dimensional point cloud[J].Sensors and Microsystems,2024,43(5):121-124.(in Chinese)

[19] 李修华,魏鹏,何嘉西,等.基于Kinect V3深度传感器的田间植株点云配准方法[J].农业工程学报,2021,37(21):45-52.LI Xiuhua,WEI Peng,HE Jiaxi,et al.Point cloud registration method of field plants based on Kinect V3 depth sensor[J].Transactions of the CSAE,2021,37(21):45-52.(in Chinese)

[20] GHAHREMANI M,WILLIAMS K,CORKE F,et al.Direct and accurate feature extraction from 3D point clouds of plants using RANSAC[J].Computers and Electronics in Agriculture,2021,187:106240.

[21] 朱启兵,张梦,刘振方,等.基于点云配准的盆栽金桔果实识别与计数方法[J].农业机械学报,2022,53(5):209-216.ZHU Qibing,ZHANG Meng,LIU Zhenfang,et al.Recognition and counting method of potted kumquat fruit based on point cloud registration[J].Transactions of the Chinese Society for Agricultural Machinery,2022,53(5):209-216.(in Chinese)

[22] RUSU R B,MARTON Z C,BLODOW N,et al.Towards 3D point cloud based object maps for household environments[J].Robotics and Autonomous Systems,2008,56(11):927-941.

[23] SEGAL A V,HAEHNEL D,THRUN S.Generalized-ICP[J].Robotics:Science and Systems,2009,2(4):435.

[24] 曾清红,卢德唐.基于移动最小二乘法的曲线曲面拟合[J].工程图学学报,2004(1):84-89.ZENG Qinghong,LU Detang.Curve and surface fitting based on moving least squares[J].Journal of Engineering Graphics,2004(1):84-89.(in Chinese)

[25] CHRISTOPH S S,SCHOELER M,PAPON J,et al.Object partitioning using local convexity[C]∥Proceedings of the IEEE Conference on Computer Vision and Pattern Recognition,2014:304-311.